Trong kỷ nguyên của Trí tuệ nhân tạo tạo sinh (Generative AI) và dữ liệu lớn (Big Data) phát triển như vũ bão, ngành Khoa học Dữ liệu năm 2026 không còn chỉ dừng lại ở việc “dự báo” mà đã tiến tới “tối ưu hóa tự trị” và “AI có đạo đức”. Đối với các bạn sinh viên, đặc biệt là khối ngành Kinh tế, Luật và Công nghệ thông tin, việc chọn đề tài nghiên cứu khoa học (NCKH) cần phải đón đầu được các xu hướng công nghệ mới nhất.

Trước khi đi sâu vào danh sách đề tài nghiên cứu khoa học ngành khoa học dữ liệu, hãy lưu ý rằng: Một đề tài hay chỉ thực sự tỏa sáng khi bạn có một bộ dữ liệu chất lượng. Đừng quên tham khảo bài viết về Cách Làm Sạch Dữ Liệu (Data Cleaning) Trước Khi Chạy SPSS để nắm vững kỹ thuật xử lý Outliers và Missing Data – những bước “xương sống” cho mọi nghiên cứu định lượng.

Nội dung bài viết

- 1 I. XU HƯỚNG ĐỀ TÀI NGHIÊN CỨU KHOA HỌC NGÀNH KHOA HỌC DỮ LIỆU NĂM 2026: BỐI CẢNH NGHIÊN CỨU

- 1.1 1. Generative AI cho các lĩnh vực chuyên biệt (Domain-Specific GenAI)

- 1.2 2. Trí tuệ nhân tạo có thể giải thích (Explainable AI – XAI)

- 1.3 3. Công nghệ bảo mật tăng cường quyền riêng tư (Privacy-Enhancing Technologies – PETs)

- 1.4 4. Dữ liệu tổng hợp (Synthetic Data): Lời giải cho cơn khát dữ liệu

- 1.5 5. Edge AI & TinyML: Trí tuệ tại “rìa” mạng

- 1.6 6. Data-Centric AI (AI lấy dữ liệu làm trung tâm)

- 2 II. DANH SÁCH 30+ ĐỀ TÀI NGHIÊN CỨU KHOA HỌC NGÀNH KHOA HỌC DỮ LIỆU CHỌN LỌC

- 2.1 Nhóm 1: Khoa Học Dữ Liệu Trong Kinh Tế, Tài Chính & Quản Trị (Phù hợp UEL)

- 2.2 Nhóm 2: Khoa Học Dữ Liệu & An Toàn Thông Tin (Cybersecurity)

- 2.3 Nhóm 3: AI Tạo Sinh (Generative AI) & Xử Lý Ngôn Ngữ Tự Nhiên (NLP)

- 2.4 Nhóm 4: Khoa Học Dữ Liệu Trong Y Tế & Đời Sống

- 2.5 Nhóm 5: Khoa Học Dữ Liệu Cho Phát Triển Bền Vững (Green AI)

- 2.6 Nhóm 6: Các Đề Tài Mang Tính Đột Phá Khác

- 3 III. PHƯƠNG PHÁP LUẬN VÀ CÔNG CỤ THỰC HIỆN NGHIÊN CỨU

- 4 IV. LỜI KHUYÊN ĐỂ CÓ MỘT ĐỀ TÀI ĐẠT GIẢI CAO

- 5 1. Tính cấp thiết: Đề tài của bạn giải quyết nỗi đau nào của xã hội 2026?

- 6 2. Tính mới: Đừng “tái chế” nghiên cứu, hãy “cải tiến” kiến trúc

- 7 3. Độ tin cậy của dữ liệu: “Garbage in, Garbage out”

- 8 4. Khả năng giải thích của mô hình (Explainable AI – XAI)

- 9 5. Kết luận thực tiễn (Actionable Insights)

- 10 V. TÀI LIỆU THAM KHẢO VÀ NGUỒN DỮ LIỆU

I. XU HƯỚNG ĐỀ TÀI NGHIÊN CỨU KHOA HỌC NGÀNH KHOA HỌC DỮ LIỆU NĂM 2026: BỐI CẢNH NGHIÊN CỨU

Bước sang năm 2026, Khoa học dữ liệu không còn là một “phép màu” xa lạ mà đã trở thành hệ điều hành của mọi nền kinh tế số. Nếu như năm 2023-2024 là sự bùng nổ của ChatGPT và Generative AI sơ khai, thì năm 2026 là kỷ nguyên của sự tinh chỉnh (fine-tuning), đạo đức (ethics) và hiệu suất (efficiency).

Dưới đây là 6 xu hướng chủ đạo mà bất kỳ nhà nghiên cứu nào cũng cần bám sát:

1. Generative AI cho các lĩnh vực chuyên biệt (Domain-Specific GenAI)

Thời đại của các mô hình ngôn ngữ lớn (LLM) đa năng đang dần nhường chỗ cho các mô hình “chuyên gia”. Thay vì dùng một AI biết tuốt nhưng đôi khi “ảo tưởng”, các nghiên cứu năm 2026 tập trung vào:

- Legal-Tech AI: Các mô hình được huấn luyện riêng trên hệ thống văn bản pháp luật, án lệ tại Việt Nam để hỗ trợ luật sư tra cứu và dự đoán kết quả tranh tụng.

- Agri-Data AI: Trong ngành bán lẻ vật tư nông nghiệp, AI không chỉ dự báo thời tiết mà còn phân tích sâu dữ liệu thị trường, chuỗi cung ứng phân bón và thuốc thú y để đưa ra chiến lược nhập hàng tối ưu.

- Fin-Data AI: Các mô hình chuyên sâu về phân tích báo cáo tài chính, có khả năng đọc hiểu các bảng cân đối kế toán phức tạp chỉ trong vài giây với độ chính xác tuyệt đối.

2. Trí tuệ nhân tạo có thể giải thích (Explainable AI – XAI)

Năm 2026, chúng ta không chấp nhận câu trả lời “AI bảo thế”. Đặc biệt trong các ngành nhạy cảm như Ngân hàng và Y tế, tính minh bạch là bắt buộc.

- Vấn đề: Các thuật toán Deep Learning vốn là những “chiếc hộp đen”. Nếu AI từ chối cho một khách hàng vay vốn, ngân hàng phải giải thích được lý do cụ thể (do điểm tín dụng, lịch sử giao dịch hay biến số nào).

- Xu hướng nghiên cứu: Sử dụng các kỹ thuật như SHAP (SHapley Additive exPlanations) hoặc LIME để “mổ xẻ” các mô hình phức tạp. Điều này giúp các nhà nghiên cứu tại UEL có thể thực hiện các đề tài về “Sự công bằng và minh bạch trong thuật toán tín dụng”.

3. Công nghệ bảo mật tăng cường quyền riêng tư (Privacy-Enhancing Technologies – PETs)

Với sự thực thi nghiêm ngặt của Nghị định 13/2023/NĐ-CP về bảo vệ dữ liệu cá nhân tại Việt Nam, việc khai thác dữ liệu mà không xâm phạm quyền riêng tư là một bài toán hóc búa.

- Federated Learning (Học liên hợp): Cho phép huấn luyện mô hình trên nhiều thiết bị khác nhau mà không cần gom dữ liệu về một máy chủ trung tâm. Dữ liệu của khách hàng ở lại trên máy của họ, chỉ có “tri thức” được gửi đi.

- Differential Privacy: Thêm “nhiễu” toán học vào dữ liệu sao cho các đặc điểm chung của tập thể vẫn được giữ nguyên nhưng danh tính cá nhân không thể bị truy ngược.

4. Dữ liệu tổng hợp (Synthetic Data): Lời giải cho cơn khát dữ liệu

Khi dữ liệu thực tế quá đắt đỏ, nhạy cảm hoặc khan hiếm (như dữ liệu về các vụ phá sản hoặc bệnh nhân mắc bệnh hiếm), các nhà khoa học dữ liệu năm 2026 quay sang dùng AI để… tạo ra dữ liệu.

- Dữ liệu tổng hợp được tạo ra từ các mô hình GANs hoặc Variational Autoencoders (VAEs) có các đặc tính thống kê giống hệt dữ liệu thật nhưng hoàn toàn không chứa thông tin cá nhân.

- Ứng dụng: Bạn có thể tạo ra 1 triệu hồ sơ khách hàng ảo để kiểm thử hệ thống phần mềm mà không lo vi phạm pháp luật.

5. Edge AI & TinyML: Trí tuệ tại “rìa” mạng

Thay vì gửi toàn bộ dữ liệu lên Cloud (đám mây) gây độ trễ lớn và tốn băng thông, các mô hình AI năm 2026 được thu nhỏ để chạy trực tiếp trên smartphone, camera giám sát hoặc các cảm biến IoT trong kho bãi nông nghiệp.

- Ví dụ: Một camera thông minh trong kho thức ăn gia súc có thể tự nhận diện sự xuất hiện của chuột hoặc sâu mọt và phát cảnh báo ngay lập tức mà không cần kết nối Internet.

6. Data-Centric AI (AI lấy dữ liệu làm trung tâm)

Thay vì mải mê tinh chỉnh thuật toán (model-centric), giới nghiên cứu đang quay lại với cốt lõi: Chất lượng dữ liệu. Andrew Ng – bậc thầy AI – đã khẳng định: “Dữ liệu sạch tốt hơn thuật toán phức tạp”.

- Xu hướng này tập trung vào việc tự động hóa quy trình làm sạch dữ liệu. Các nhà nghiên cứu sẽ tập trung vào việc xây dựng các “pipeline” tự động phát hiện outliers và xử lý missing data một cách thông minh, thay vì làm thủ công như trước đây.

II. DANH SÁCH 30+ ĐỀ TÀI NGHIÊN CỨU KHOA HỌC NGÀNH KHOA HỌC DỮ LIỆU CHỌN LỌC

Nhóm 1: Khoa Học Dữ Liệu Trong Kinh Tế, Tài Chính & Quản Trị (Phù hợp UEL)

- Ứng dụng mô hình Hybrid (LSTM-GRU) trong dự báo biến động giá nông sản tại thị trường Việt Nam: Nghiên cứu tập trung vào việc giúp các hộ kinh doanh vật tư nông nghiệp tối ưu hóa lượng hàng tồn kho.

- Phân tích cảm xúc đa kênh (Multi-channel Sentiment Analysis) để dự báo hành vi người tiêu dùng trong thương mại điện tử xuyên biên giới: Sử dụng dữ liệu từ Shopee, Lazada và TikTok Shop.

- Xây dựng hệ thống phát hiện gian lận tín dụng (Credit Fraud Detection) dựa trên học máy không giám sát cho các ngân hàng số tại Việt Nam.

- Tác động của dữ liệu lớn đến quy trình ra quyết định của các doanh nghiệp bán lẻ quy mô vừa và nhỏ (SMEs).

- Dự báo khả năng rời bỏ dịch vụ (Churn Prediction) của khách hàng ngành Fintech bằng thuật toán XGBoost kết hợp với SHAP để giải thích mô hình.

- Tối ưu hóa chuỗi cung ứng nông nghiệp bằng học tăng cường (Reinforcement Learning) trong bối cảnh biến đổi khí hậu.

- Đánh giá rủi ro vỡ nợ của các doanh nghiệp niêm yết trên sàn HOSE sử dụng mô hình Random Forest và mạng Neural.

Nhóm 2: Khoa Học Dữ Liệu & An Toàn Thông Tin (Cybersecurity)

- Phát hiện xâm nhập mạng (IDS) dựa trên phân tích lưu lượng thời gian thực sử dụng Deep Learning.

- Ứng dụng Federated Learning (Học liên hợp) để bảo vệ quyền riêng tư trong chia sẻ dữ liệu y tế giữa các bệnh viện.

- Phân tích hành vi người dùng (UEBA) để phát hiện các mối đe dọa nội bộ trong hệ thống quản lý dữ liệu doanh nghiệp.

- Xây dựng mô hình tự động phát hiện mã độc mã hóa (Ransomware) dựa trên các đặc trưng tệp tin và hành vi hệ thống.

- Nghiên cứu giải pháp bảo mật dữ liệu cho các giao dịch xuyên biên giới trong thương mại điện tử theo quy định pháp luật Việt Nam.

Nhóm 3: AI Tạo Sinh (Generative AI) & Xử Lý Ngôn Ngữ Tự Nhiên (NLP)

- Tối ưu hóa mô hình ngôn ngữ lớn (LLMs) cho việc tra cứu văn bản pháp luật Việt Nam: Một đề tài cực hay cho sinh viên Luật kết hợp Khoa học dữ liệu.

- Sử dụng GANs (Generative Adversarial Networks) để tạo dữ liệu tổng hợp hỗ trợ huấn luyện mô hình dự báo tài chính khi thiếu dữ liệu thực.

- Xây dựng Chatbot thông minh hỗ trợ tư vấn kỹ thuật nông nghiệp và chẩn đoán bệnh cây trồng dựa trên ảnh chụp.

- Phân tích xu hướng chuyển dịch ngôn ngữ trong các bản dịch từ tiếng Trung sang tiếng Việt bằng mô hình Transformer.

Nhóm 4: Khoa Học Dữ Liệu Trong Y Tế & Đời Sống

- Dự đoán cá nhân hóa phác đồ điều trị dựa trên dữ liệu biểu hiện gen và học máy.

- Phân tích dữ liệu từ thiết bị đeo thông minh (Wearables) để cảnh báo sớm rủi ro đột quỵ ở người cao tuổi.

- Ứng dụng Computer Vision trong nhận diện và phân loại sâu bệnh trên cây lúa qua ảnh chụp từ Drone.

- Phân tích tác động của ô nhiễm không khí đến sức khỏe cộng đồng tại các đô thị lớn bằng mô hình hồi quy đa biến.

Nhóm 5: Khoa Học Dữ Liệu Cho Phát Triển Bền Vững (Green AI)

- Tối ưu hóa tiêu thụ năng lượng trong các trung tâm dữ liệu (Data Center) bằng AI.

- Dự báo nhu cầu năng lượng tái tạo (điện mặt trời, điện gió) dựa trên dữ liệu khí tượng thủy văn.

- Xây dựng bản đồ rủi ro thiên tai và hạn mặn tại Đồng bằng sông Cửu Long sử dụng viễn thám và Big Data.

- Phân tích hiệu quả của các chính sách kinh tế xanh dựa trên mô hình định lượng.

Nhóm 6: Các Đề Tài Mang Tính Đột Phá Khác

- Hệ thống gợi ý (Recommendation System) đa mục tiêu: Cân bằng giữa lợi nhuận doanh nghiệp và trải nghiệm người dùng.

- Phân tích mạng lưới xã hội (Social Network Analysis) để phát hiện tin giả (Fake News) trên các nền tảng mạng xã hội.

- Ứng dụng Edge Computing kết hợp Data Science trong quản lý đô thị thông minh (Smart City).

- Đánh giá mức độ sẵn sàng về dữ liệu (Data Readiness) của các doanh nghiệp Nhà nước trong tiến trình chuyển đổi số.

- Phát triển thuật toán học máy có khả năng chống lại các cuộc tấn công đối kháng (Adversarial Attacks).

- Nghiên cứu sự công bằng (Fairness) trong các thuật toán tuyển dụng nhân sự tự động.

III. PHƯƠNG PHÁP LUẬN VÀ CÔNG CỤ THỰC HIỆN NGHIÊN CỨU

Để thực hiện một đề tài Khoa học dữ liệu chất lượng, bạn cần tuân thủ quy trình chuẩn CRISP-DM (Cross-Industry Standard Process for Data Mining):

- Thấu hiểu bài toán (Business Understanding): Xác định rõ mục tiêu nghiên cứu. Ví dụ: Bạn muốn giảm sai số dự báo hay muốn tìm ra các nhân tố ảnh hưởng?

- Thấu hiểu dữ liệu (Data Understanding): Thu thập dữ liệu từ các nguồn uy tín như Kaggle, World Bank Open Data, hoặc dữ liệu thực tế từ doanh nghiệp.

- Chuẩn bị dữ liệu (Data Preparation): Đây là bước quan trọng nhất. Nếu bạn sử dụng SPSS, hãy nhớ áp dụng các kỹ thuật xử lý Missing Data mà chúng tôi đã đề cập trong bài viết trước.

- Xây dựng mô hình (Modeling): Sử dụng Python (Scikit-learn, TensorFlow, PyTorch) hoặc R. Với các nghiên cứu kinh tế lượng thuần túy, SPSS và Stata vẫn là những công cụ cực kỳ mạnh mẽ.

- Đánh giá (Evaluation): Sử dụng các chỉ số như RMSE, MAE cho bài toán hồi quy; Accuracy, F1-score cho bài toán phân loại.

- Triển khai (Deployment): Trình bày kết quả nghiên cứu dưới dạng dashboard (PowerBI, Tableau) hoặc viết bài báo khoa học.

IV. LỜI KHUYÊN ĐỂ CÓ MỘT ĐỀ TÀI ĐẠT GIẢI CAO

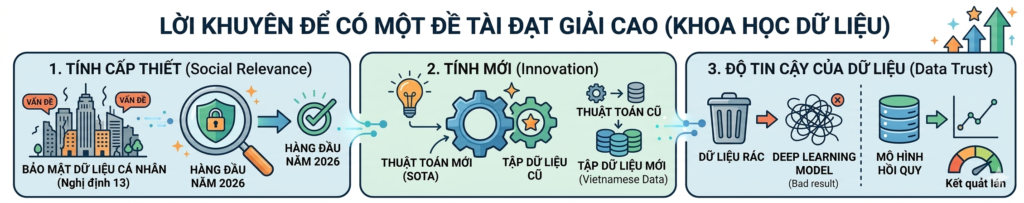

Trong Khoa học dữ liệu, ranh giới giữa một đồ án môn học thông thường và một công trình NCKH đạt giải nằm ở tư duy giải quyết vấn đề (Problem-solving) và sự khắt khe trong thực nghiệm. Để thuyết phục những giám khảo khó tính nhất năm 2026, đề tài của bạn cần hội tụ đủ 3 yếu tố “Kiềng ba chân” sau:

1. Tính cấp thiết: Đề tài của bạn giải quyết nỗi đau nào của xã hội 2026?

Một sai lầm kinh điển của sinh viên Data Science là chọn những đề tài “kinh điển” nhưng đã lỗi thời như: Dự báo giá nhà Boston, Phân loại hoa Iris hay Nhận diện chữ số viết tay MNIST. Những đề tài này không còn tính cấp thiết.

Năm 2026, hội đồng giám khảo tìm kiếm những đề tài chạm đúng vào các “điểm nóng” của thực đại:

- Bảo mật dữ liệu và Quyền riêng tư (Data Privacy): Với sự thực thi nghiêm ngặt của Nghị định 13/2023/NĐ-CP, các đề tài về Differential Privacy (Quyền riêng tư vi phân) hoặc Federated Learning (Học máy liên kết) nhằm bảo vệ thông tin cá nhân trong khi vẫn đảm bảo hiệu suất mô hình đang là “mỏ vàng” để đoạt giải.

- Dự báo khủng hoảng và Biến đổi khí hậu: Sử dụng dữ liệu vệ tinh và chuỗi thời gian để dự báo sớm các hiện tượng cực đoan (xâm nhập mặn tại ĐBSCL, sạt lở đất tại miền Trung).

- Khoa học dữ liệu trong Y tế (Health Data Science): Chẩn đoán bệnh sớm qua dữ liệu đa ôm (Multi-omics) hoặc tối ưu hóa lộ trình điều trị cá nhân hóa.

💡 Lời khuyên: Hãy bắt đầu bài thuyết trình bằng câu hỏi: “Tại sao thế giới/Việt Nam cần nghiên cứu này NGAY BÂY GIỜ?”. Nếu bạn không trả lời được, đề tài của bạn chưa đủ tầm NCKH.

2. Tính mới: Đừng “tái chế” nghiên cứu, hãy “cải tiến” kiến trúc

Tính mới trong Data Science không bắt buộc bạn phải phát minh ra một thuật toán thay thế Transformer. Bạn có thể tạo ra tính mới thông qua các hướng sau:

2.1. Áp dụng thuật toán mới (State-of-the-Art – SOTA) vào tập dữ liệu cũ

Nếu các nghiên cứu trước đây chỉ dùng Random Forest hay XGBoost để dự báo nợ xấu ngân hàng, bạn hãy thử áp dụng TabNet (mạng nơ-ron dành cho dữ liệu bảng) hoặc các mô hình Graph Neural Networks (GNN) để phân tích mối quan hệ giữa các chủ nợ. Sự thay đổi về mặt công nghệ giúp mô hình hiểu dữ liệu sâu hơn chính là tính mới.

2.2. Xây dựng tập dữ liệu mới (New Dataset)

Trong NCKH, việc bạn tự thu thập (Crawl), làm sạch và dán nhãn (Labeling) cho một bộ dữ liệu đặc thù của Việt Nam (Ví dụ: Dữ liệu giao thông thông minh tại TP.HCM, Dữ liệu phản hồi khách hàng bằng tiếng lóng/Teencode) được đánh giá cực kỳ cao. Đôi khi, “Dữ liệu mới” giá trị hơn “Thuật toán mới”.

2.3. Hướng tiếp cận đa phương thức (Multimodal Approach)

Thay vì chỉ dự báo chứng khoán dựa trên con số (Numeric), bạn kết hợp thêm phân tích cảm xúc từ tin tức báo chí (Text) và xu hướng video trên TikTok (Visual). Sự giao thoa này chính là đỉnh cao của tính mới trong năm 2026.

3. Độ tin cậy của dữ liệu: “Garbage in, Garbage out”

Đây là phần hội đồng khoa học sẽ “soi” kỹ nhất. Một mô hình dù phức tạp đến đâu (Deep Learning 100 lớp) cũng sẽ trở nên vô giá trị nếu chạy trên dữ liệu rác.

3.1. Quy trình làm sạch dữ liệu (Data Cleaning) khắt khe

Hãy chứng minh cho hội đồng thấy bạn đã xử lý dữ liệu chuyên nghiệp như thế nào:

- Xử lý Outliers (Giá trị ngoại lai): Bạn dùng Z-score hay IQR? Tại sao bạn xóa nó hay tại sao bạn giữ lại?

- Missing Values (Dữ liệu thiếu): Bạn xóa bỏ hay dùng các kỹ thuật Imputation (MICE, KNN Imputer)?

- Feature Engineering: Bạn đã tạo ra những biến phái sinh nào có giá trị? Ví dụ: Từ “Ngày sinh” bạn tạo ra biến “Thế hệ” (Gen Z, Gen Alpha) để mô hình bắt được xu hướng hành vi.

3.2. Sự trung thực trong thực nghiệm

Một sai lầm chết người là Data Leakage (Rò rỉ dữ liệu) – khi thông tin từ tập Test lọt vào tập Train làm Accuracy (độ chính xác) cao ảo (99.9%).

- Lời khuyên: Hãy sử dụng K-Fold Cross Validation để chứng minh tính ổn định của mô hình. Nếu kết quả của bạn “quá đẹp”, hãy tự nghi ngờ nó trước khi hội đồng nghi ngờ bạn.

Trích dẫn đắt giá cho báo cáo: “Một mô hình Hồi quy đơn giản (Linear Regression) chạy trên tập dữ liệu sạch, được hiểu rõ về bản chất, luôn có giá trị khoa học hơn một mạng Deep Learning phức tạp chạy trên dữ liệu nhiễu và không có khả năng giải thích (Explainability).”

4. Khả năng giải thích của mô hình (Explainable AI – XAI)

Năm 2026, hội đồng không còn chấp nhận các mô hình “Hộp đen” (Black box). Bạn cần giải thích được: Tại sao AI lại đưa ra kết quả đó?

- Hãy sử dụng các kỹ thuật như SHAP (SHapley Additive exPlanations) hoặc LIME để trực quan hóa mức độ ảnh hưởng của từng biến đến kết quả cuối cùng.

- Nếu bạn chứng minh được: “Biến A tác động 30% đến khả năng rời bỏ dịch vụ của khách hàng”, đề tài của bạn sẽ có tính thuyết phục cực lớn đối với các giám khảo thực chiến.

5. Kết luận thực tiễn (Actionable Insights)

Đừng kết thúc đề tài ở con số F1-Score 0.92. Hãy kết thúc bằng việc: Số 0.92 đó giúp gì cho con người?

- Giúp doanh nghiệp tiết kiệm bao nhiêu tỷ đồng?

- Giúp bác sĩ giảm bao nhiêu % thời gian chẩn đoán?

- Giúp xã hội giảm thiểu bao nhiêu vụ lừa đảo qua mạng?

V. TÀI LIỆU THAM KHẢO VÀ NGUỒN DỮ LIỆU

Để bài nghiên cứu thêm sức nặng, hãy tham khảo các nguồn uy tín:

- Google Scholar: Tìm kiếm các bài báo khoa học liên quan.

- Towards Data Science: Cập nhật các kỹ thuật mới nhất.

- HBR (Harvard Business Review): Góc nhìn quản trị về dữ liệu.